Глубокие нейронные сети

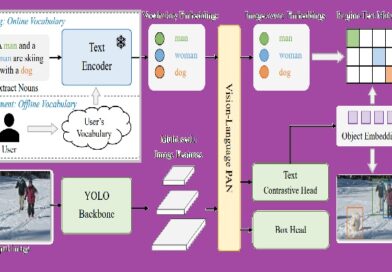

Обучение PP-PicoDet для детектирования объектов

Что это за модель PicoDet — это модель для слабых вычислительных систем, которая заявляется, как более качественная и быстрая альтернатива

Компьютерное зрение

iANPR2 — SDK для распознавания автомобильных номеров. Быстрое развертывание

Что такое iANPR2 iANPR 2 – это комплект средств разработки для распознавания автомобильных номеров второго поколения. Изначально разрабатывалась для возможности

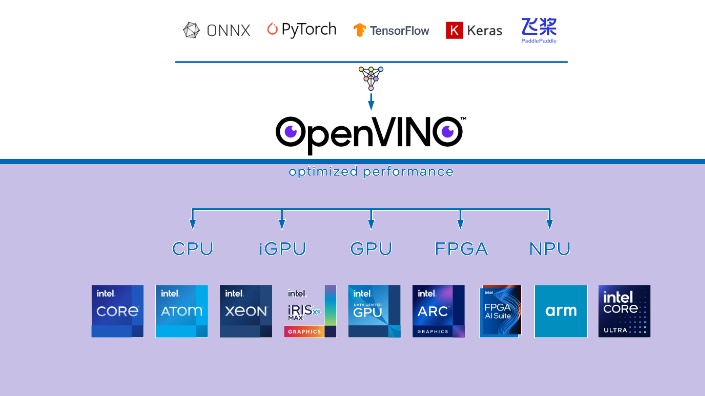

Сопутствующие технологии

NVIDIA Triton Inference Server — запуск на Ubuntu

NVIDIA Triton Inference Server представляет собой веб-сервер, на котором запускаются модели распознавания образов. Доступ через http(s) и возможен через GRPC.